小白也能懂,手把手教你 Windows 10 部署 OpenClaw 并接入飞书,打造你的私人 AI 助理!

最近几个月,OpenClaw 这个开源项目真的火出圈了。身边好几个朋友都在问:“这玩意儿到底怎么装?能不能在飞书里用?”说实话,一开始我也被它的文档绕晕过——一会儿要配 Node.js,一会儿又是 Git、PowerShell 权限、飞书回调地址……但折腾几次之后,发现其实只要踩对坑,整个过程比想象中简单得多。

今天我就把我在 Windows 10 上从零开始部署 OpenClaw,并成功接入飞书的全过程,毫无保留地写出来。不玩虚的,全是实操步骤,连“为什么卡在这一步”的坑我都给你标清楚。哪怕你是第一次接触命令行的小白,照着做也能跑起来。

先说点实在的:你得准备啥?

别急着开干,先看看你的电脑符不符合基本要求:

- 操作系统:Windows 10 或 11(64位),我用的是 Win10 专业版 22H2

- 内存:至少 4GB,建议 8GB 以上(OpenClaw 跑起来会吃点内存)

- 磁盘空间:留出 2GB 以上空闲(C 盘别太满)

- 网络:能正常访问 GitHub、Node.js 官网,最好有稳定的网络(国内用户可能需要耐心等下载)

另外,你需要:

- 一个 飞书开发者账号(个人免费注册就行)

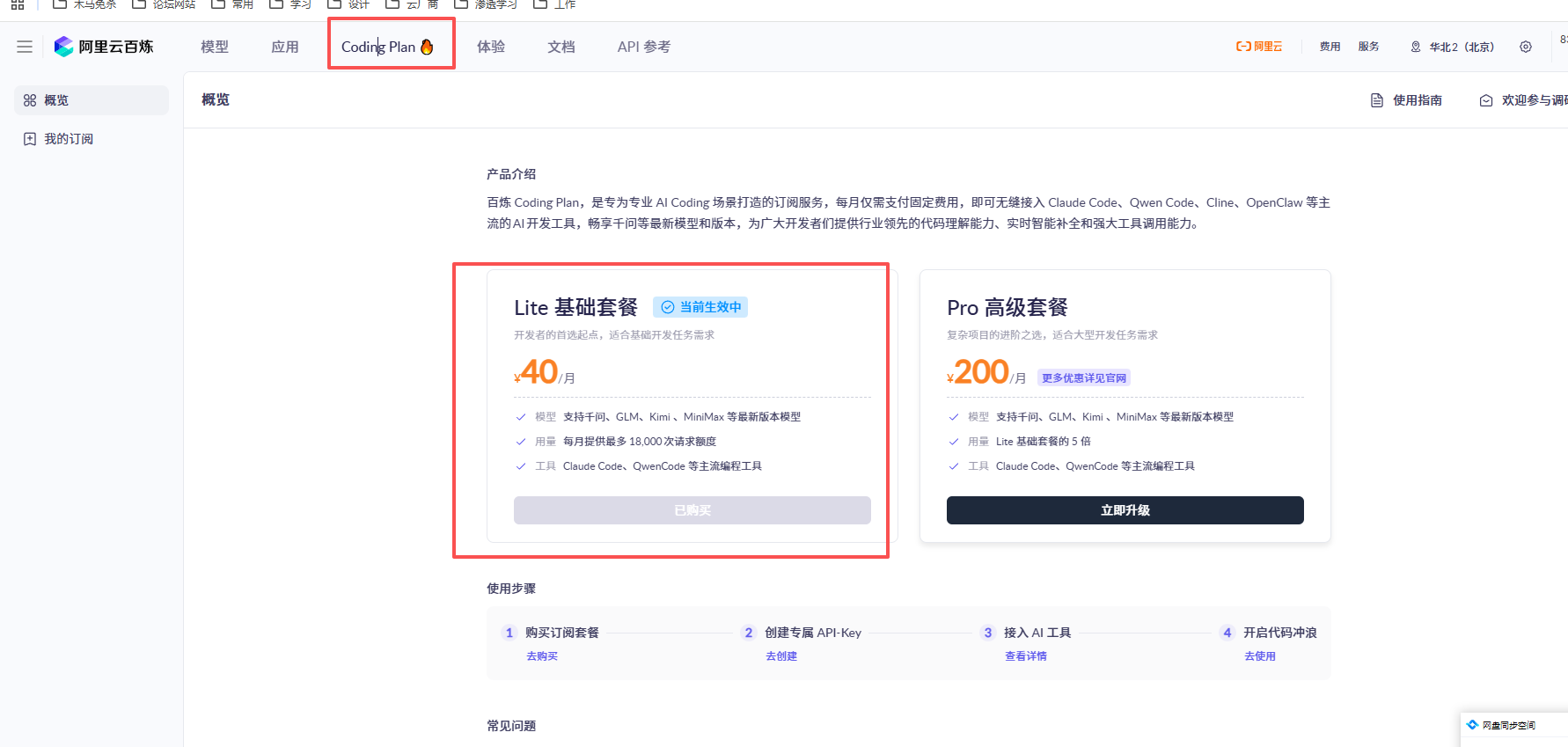

- 一个 大模型 API Key(比如豆包、Minimax、火山引擎等,国内可用),这里我用阿里百炼 首月只要7块钱

第一步:装好基础环境(Node.js + Git)

OpenClaw 是基于 Node.js 开发的,所以第一步必须装好它。

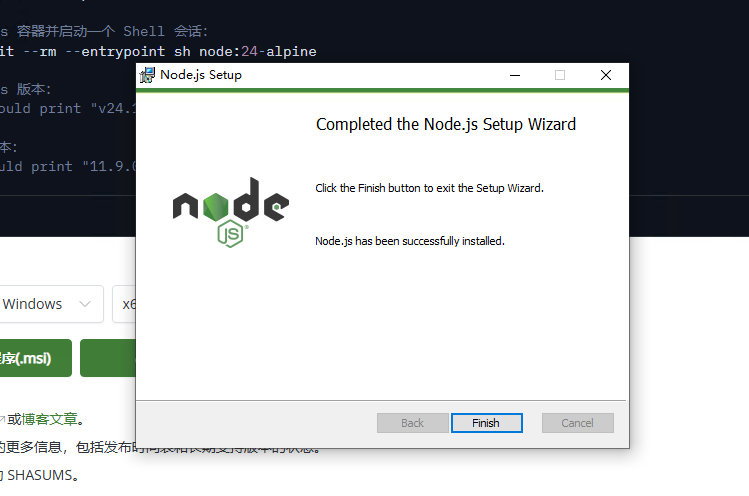

1. 安装 Node.js

打开 Node.js 官网 1,点击绿色的 “Windows Installer (.msi)” 下载安装包(推荐 LTS 版或最新版,目前我用的是 v24.13.0)。

安装时最关键的一点:

✅ 务必勾选 “Add to PATH” 和 “Automatically install the necessary tools”

这两个选项决定了后面能不能顺利运行命令。其他一路默认下一步就行。

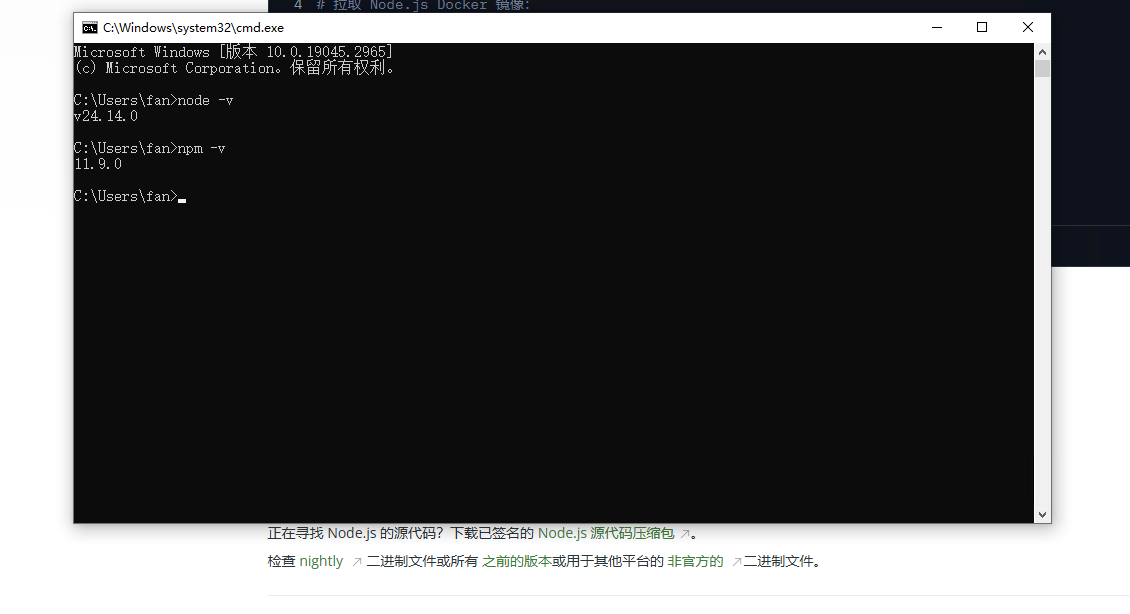

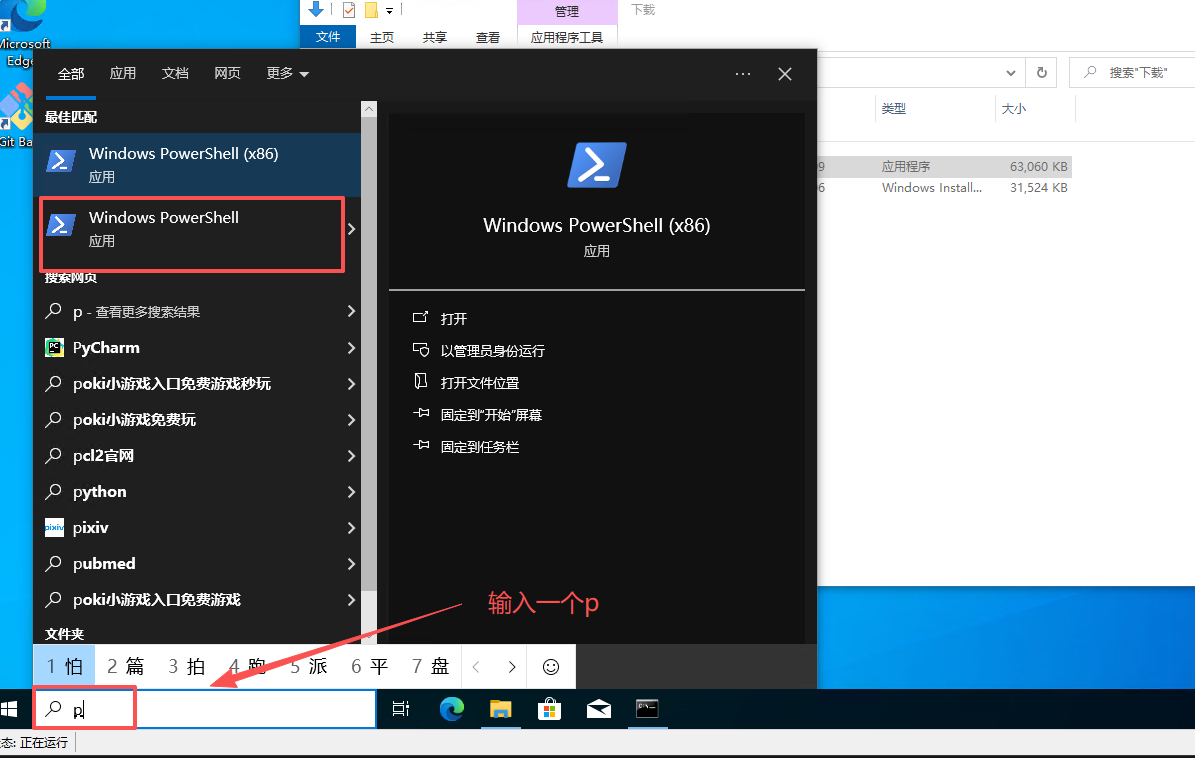

装完后,打开 PowerShell(以管理员身份运行),输入:

node -v

npm -v如果看到类似 v24.13.0 和 10.5.0 的版本号,说明装好了。

⚠️ 注意:有些老教程说用 Node.js 18 或 20,但实测 OpenClaw 最新版(2026.3)在 Node 24 上最稳,低于 22 可能直接报错。

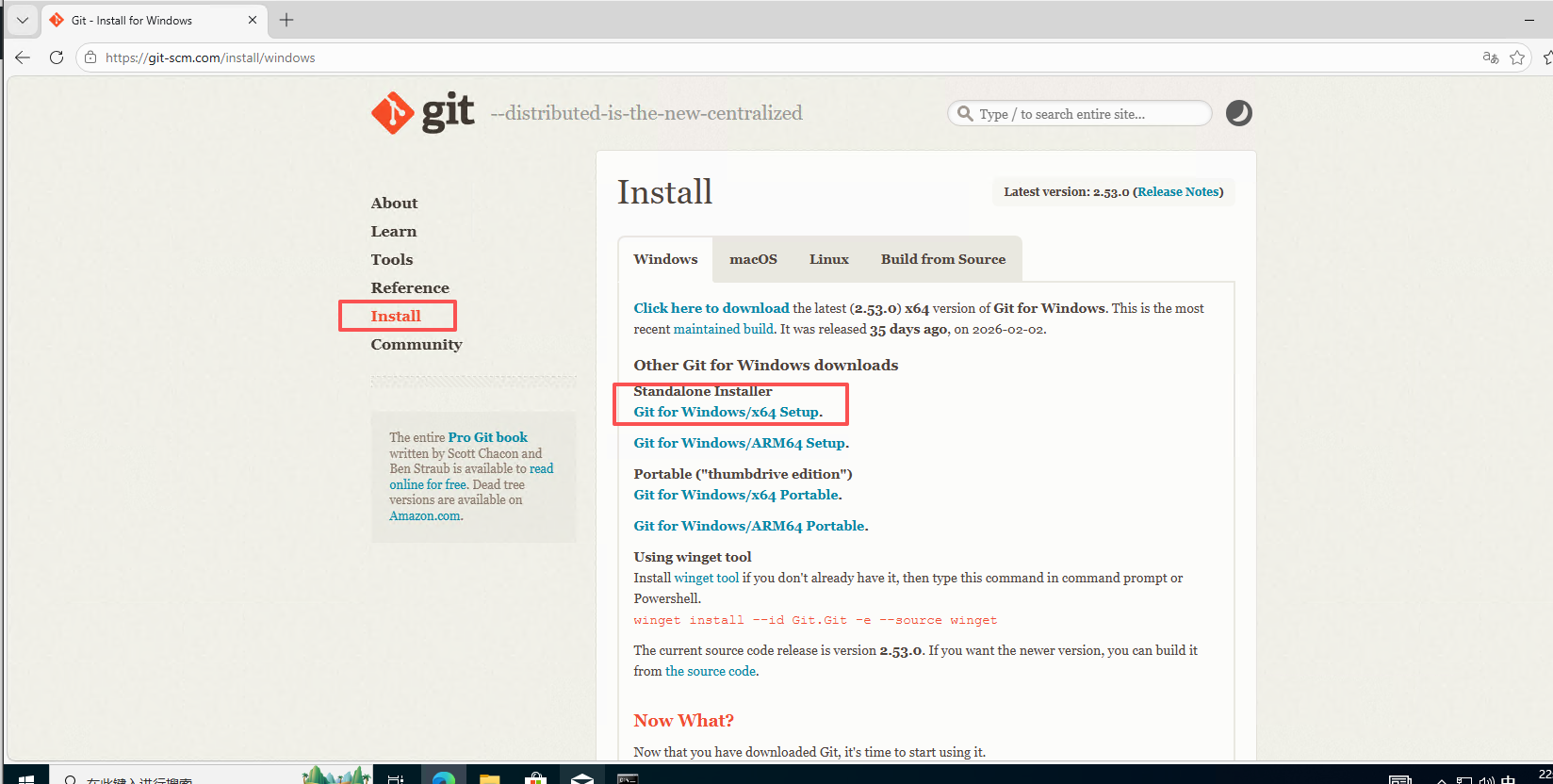

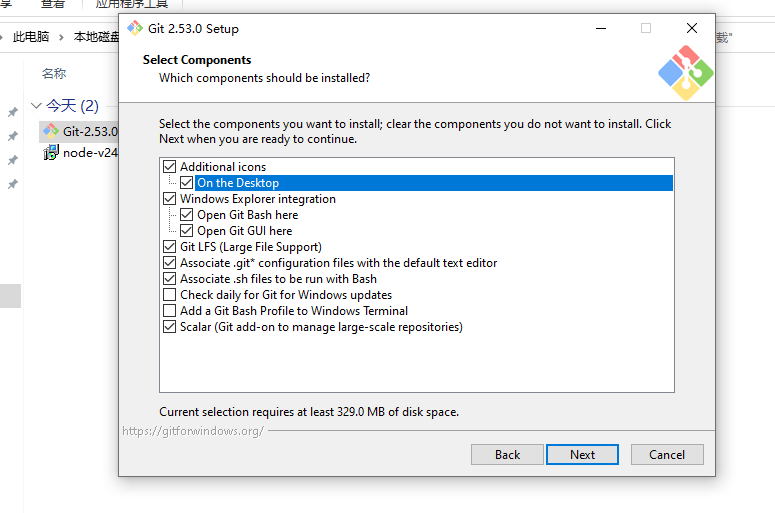

2. 安装 Git

去 Git 官网 2 下载安装包。国内网速慢是常态,耐心等。

一路下一步

安装过程中,在 “Adjusting your PATH environment” 这一步,选择:

Git from the command line and also from 3rd-party software

这样 PowerShell 才能识别 git 命令。

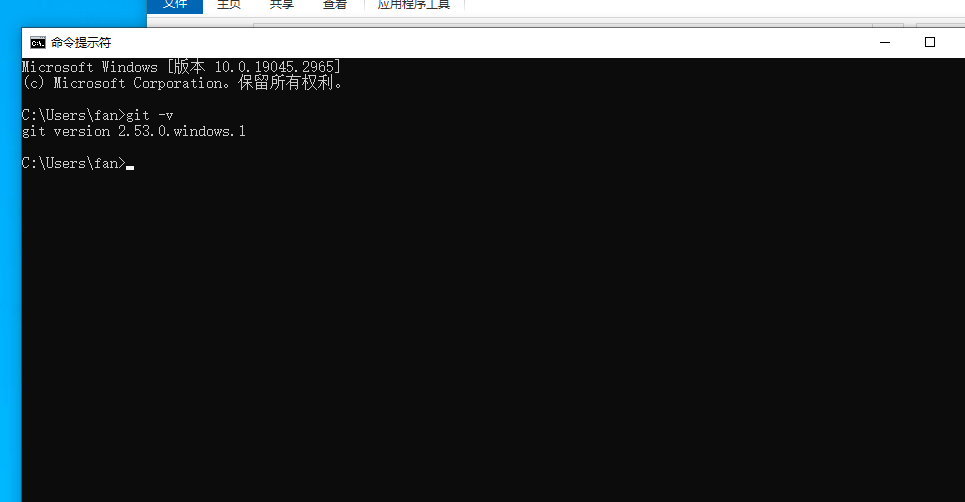

装完同样验证一下:

git --version看到版本号就 OK。

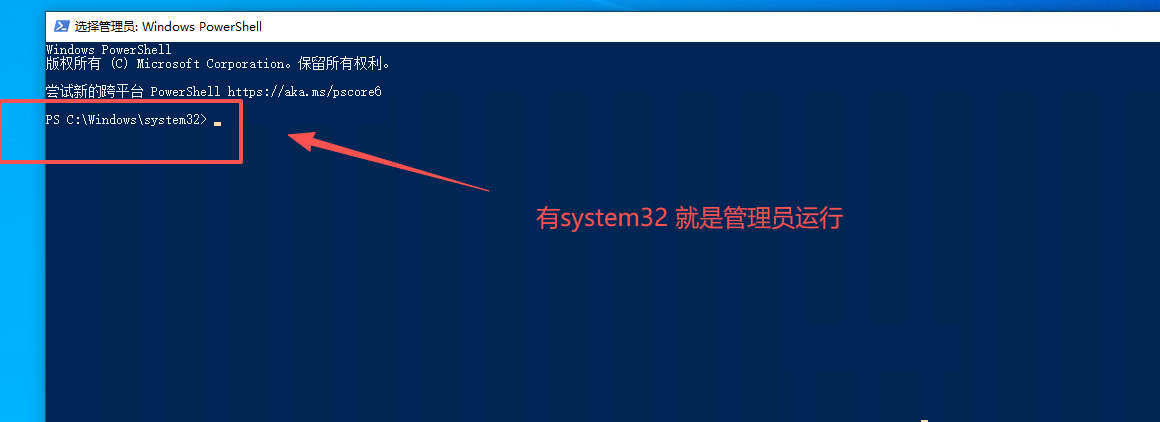

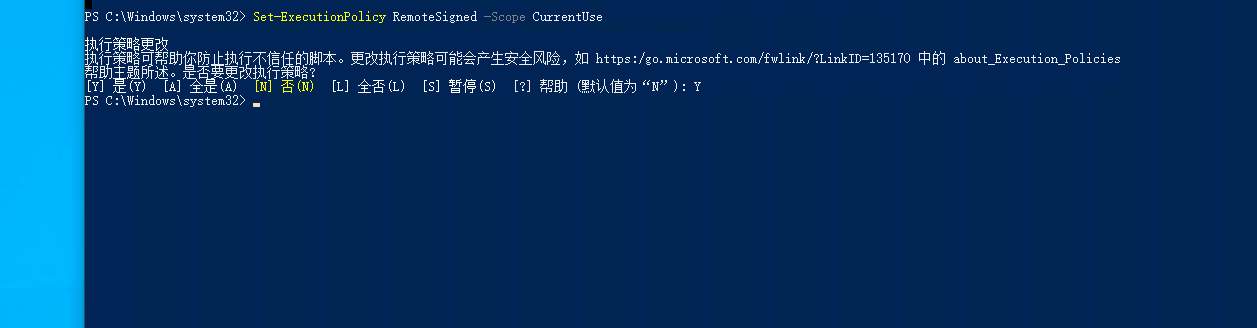

第二步:解除 PowerShell 脚本限制

Windows 默认禁止执行远程脚本,所以我们得先放行。

在 管理员权限的 PowerShell 中执行:

Set-ExecutionPolicy RemoteSigned -Scope CurrentUser

Set-ExecutionPolicy -Scope Process -ExecutionPolicy Bypass系统会问你是否确认,输入 Y 回车就行。

这一步做完,后面才能顺利运行安装脚本。

第三步:安装 OpenClaw

现在主角登场。

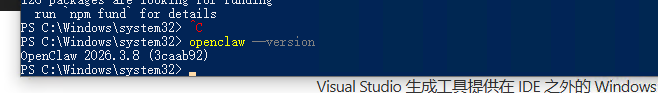

iwr -useb https://openclaw.ai/install.ps1 | iex装完后验证:

openclaw --version看到版本号(比如 2026.3.8)就说明成功了。

第四步:首次配置(关键!选 QuickStart)

接下来运行配置向导:

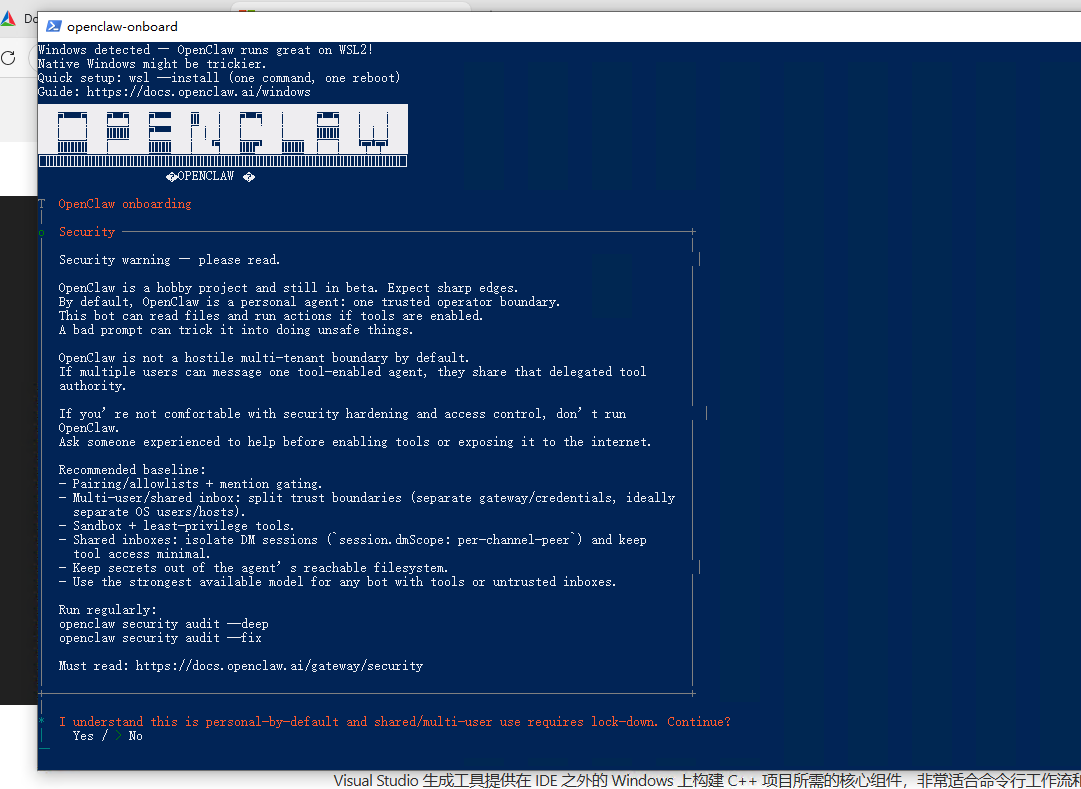

openclaw onboard --install-daemon

这里有几个选择,务必按我说的选,不然容易翻车:

配置项 配置内容 I understand this is powerful and inherently risky. Continue? 选择 ”Yes” Onboarding mode 选择 “QuickStart” Model/auth provider 选择 “Skip for now”,后续可以配置 Filter models by provider 选择 “All providers” Default model 使用默认配置 Select channel (QuickStart) 选择 “Skip for now”,后续可以配置 Configure skills now? (recommended) 选择 “No”,后续可以配置。 Enable hooks? 按空格键选中,选择“Skip for now”,按回车键进入下一步。 How do you want to hatch your bot? 选择 “Hatch in TUI”。

注册阿里百炼

1、打开网址:https://bailian.console.aliyun.com/cn-beijing/#/home

2、登录账号

3、订阅基础套餐,首月7块

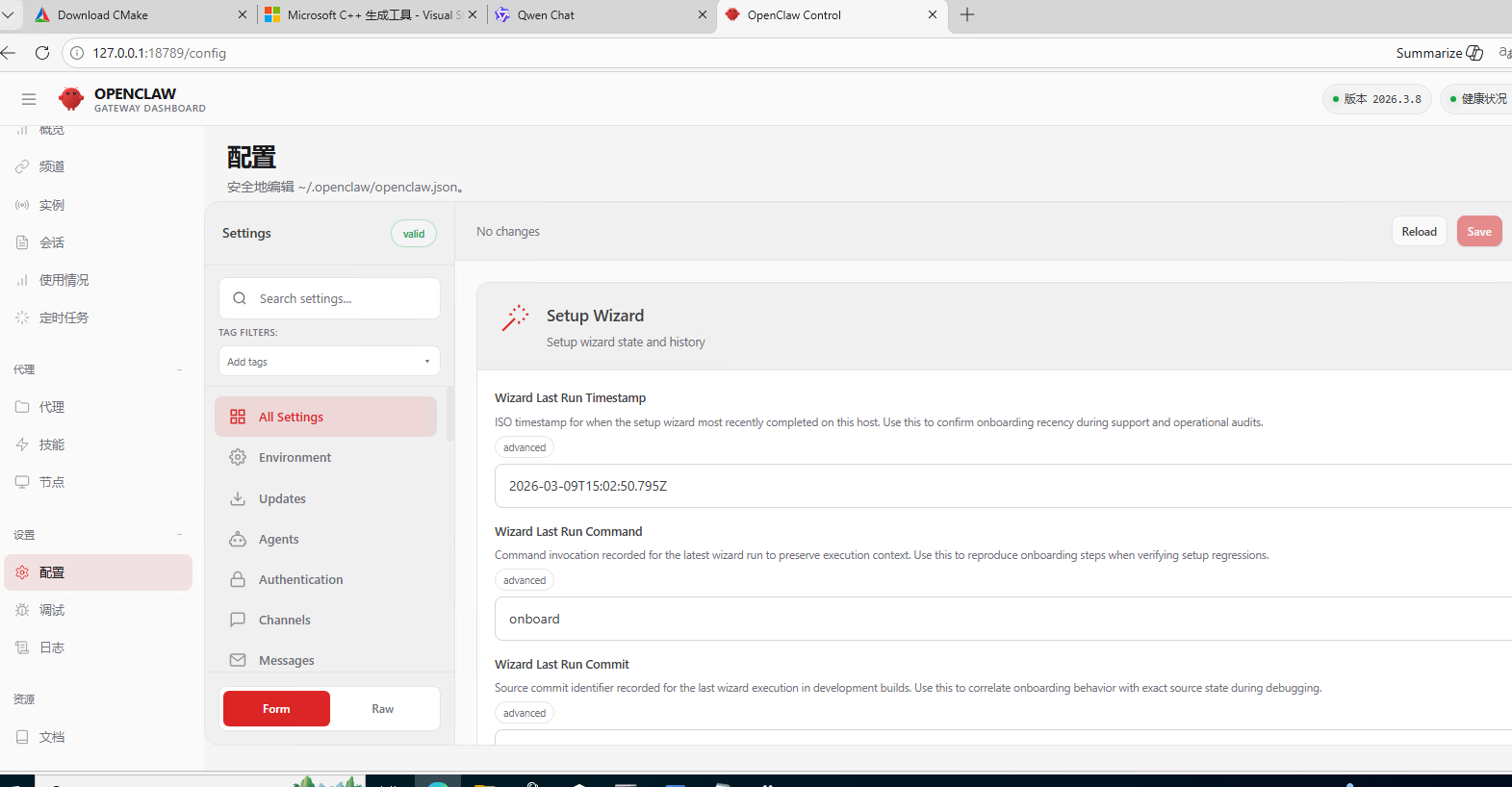

开始配置龙虾

复制以下内容到Raw JSONS输入框,替换已有内容。

若需保留已有配置,请勿直接全量替换,详见已有配置如何安全修改?

将

YOUR_API_KEY替换为Coding Plan 专属 API Key。{ "models": { "mode": "merge", "providers": { "bailian": { "baseUrl": "https://coding.dashscope.aliyuncs.com/v1", "apiKey": "YOUR_API_KEY", "api": "openai-completions", "models": [ { "id": "qwen3.5-plus", "name": "qwen3.5-plus", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "qwen3-max-2026-01-23", "name": "qwen3-max-2026-01-23", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-next", "name": "qwen3-coder-next", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536 }, { "id": "qwen3-coder-plus", "name": "qwen3-coder-plus", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 1000000, "maxTokens": 65536 }, { "id": "MiniMax-M2.5", "name": "MiniMax-M2.5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 196608, "maxTokens": 32768 }, { "id": "glm-5", "name": "glm-5", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384 }, { "id": "glm-4.7", "name": "glm-4.7", "reasoning": false, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 202752, "maxTokens": 16384 }, { "id": "kimi-k2.5", "name": "kimi-k2.5", "reasoning": false, "input": ["text", "image"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 32768 } ] } } }, "agents": { "defaults": { "model": { "primary": "bailian/qwen3.5-plus" }, "models": { "bailian/qwen3.5-plus": {}, "bailian/qwen3-max-2026-01-23": {}, "bailian/qwen3-coder-next": {}, "bailian/qwen3-coder-plus": {}, "bailian/MiniMax-M2.5": {}, "bailian/glm-5": {}, "bailian/glm-4.7": {}, "bailian/kimi-k2.5": {} } } }, "gateway": { "mode": "local" } }养虾成功

切换模型

在当前会话切换模型(临时有效)

在终端输入

openclaw tui,进入 TUI 界面,使用/model <模型名称>在当前会话中切换模型。

/model qwen3-coder-next界面返回提示“model set to qwen3-coder-next” 即表示生效。

切换默认模型(永久有效)

如需在每次新会话中使用指定模型,修改

agents.defaults.model.primary字段为目标模型。请参考修改配置文件。

{

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen3.5-plus"

}

}

}

}第五步:正式对接飞书(重点来了!)

现在我们来手动接入飞书。

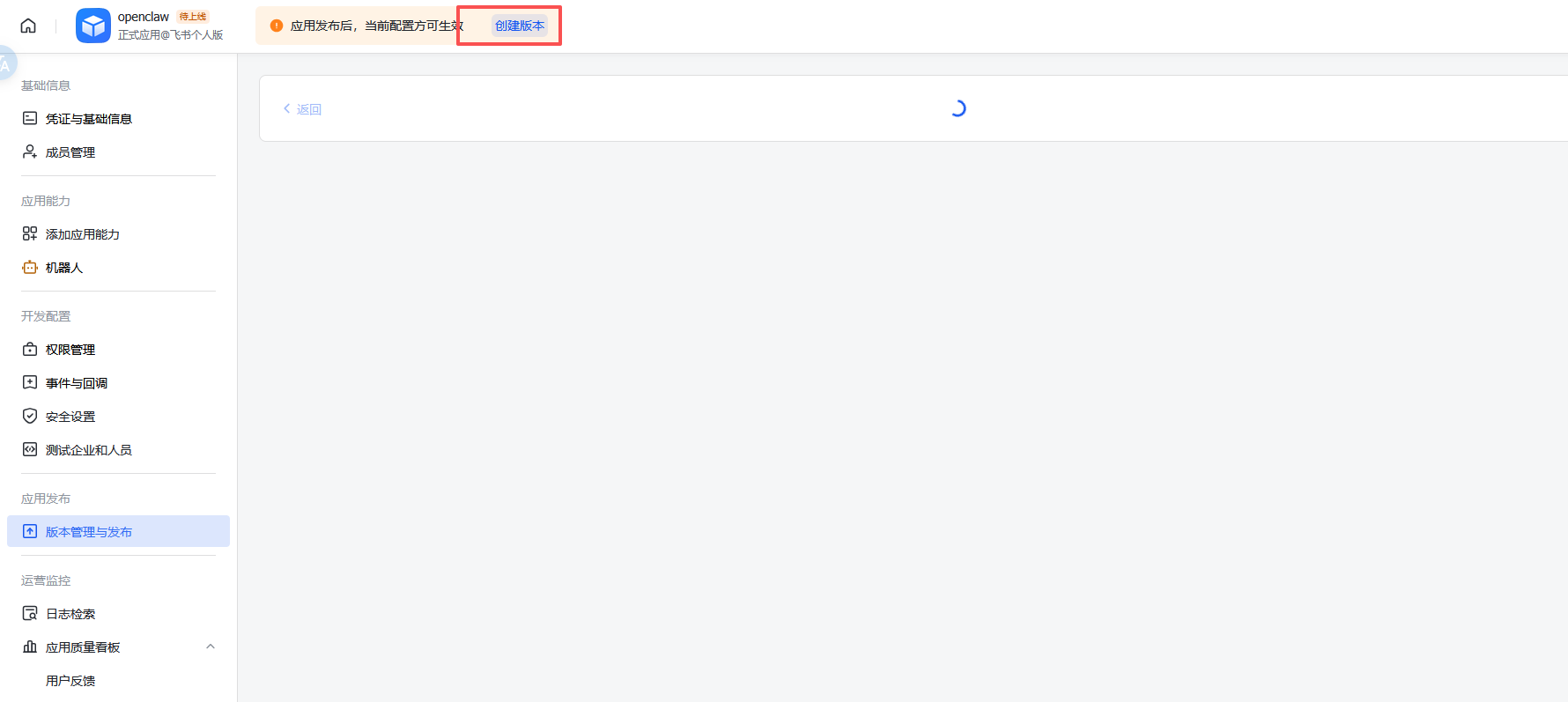

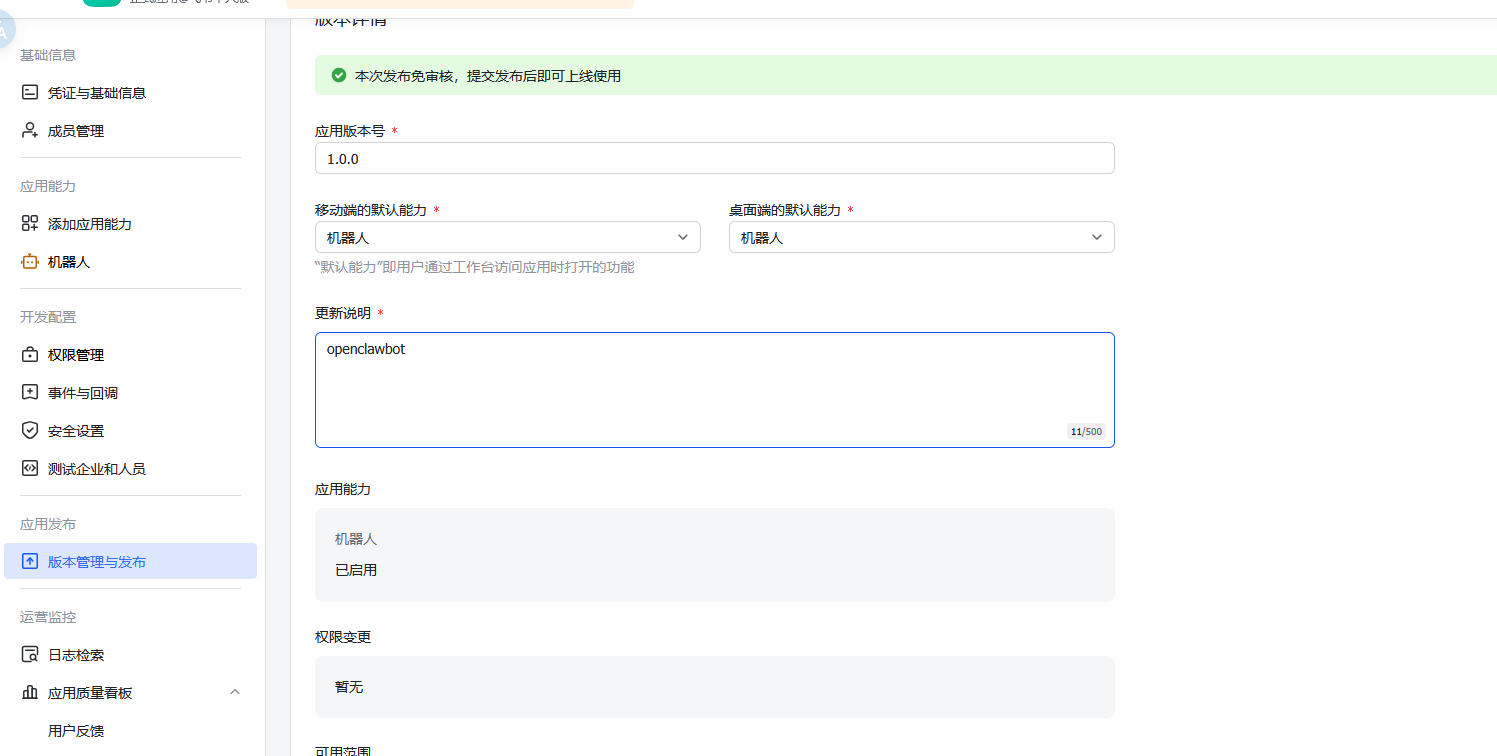

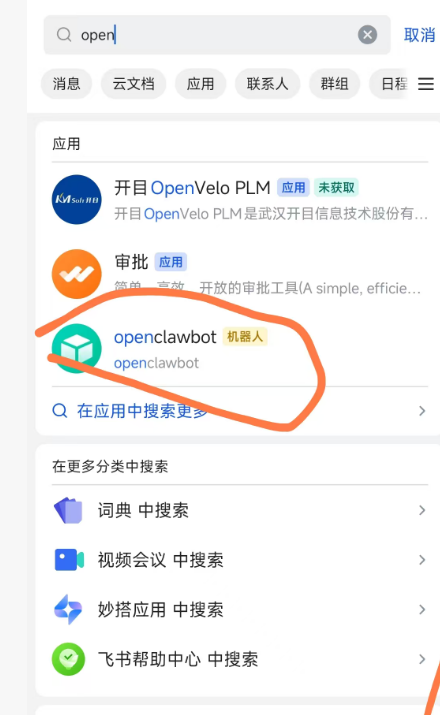

1. 在飞书开放平台创建应用

- 打开 飞书开放平台 3

- 登录后,点击「创建企业自建应用」

- 填写应用名称(比如 “我的 AI 助理”),上传个图标,确定

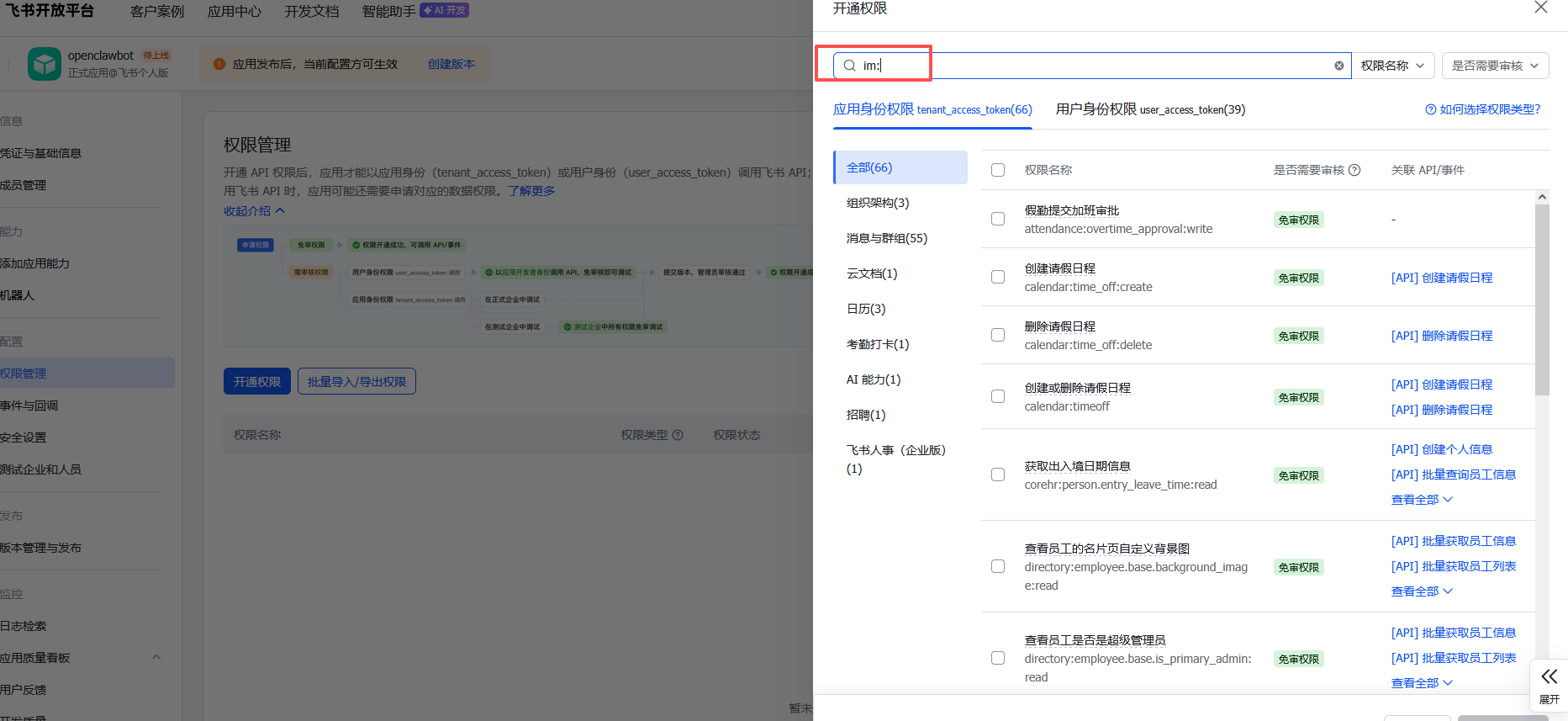

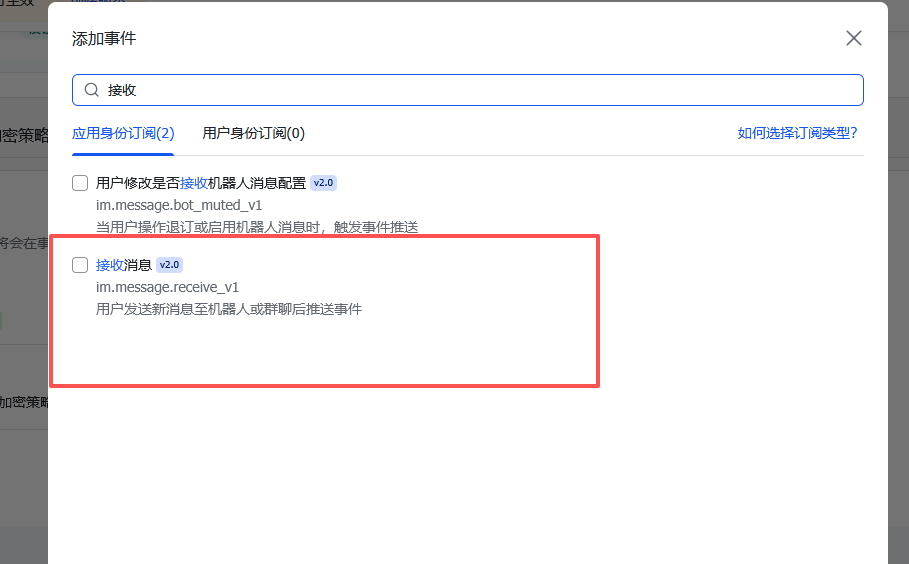

权限管理 → 添加以下权限:

im:messageim:resourcecontact:user.read

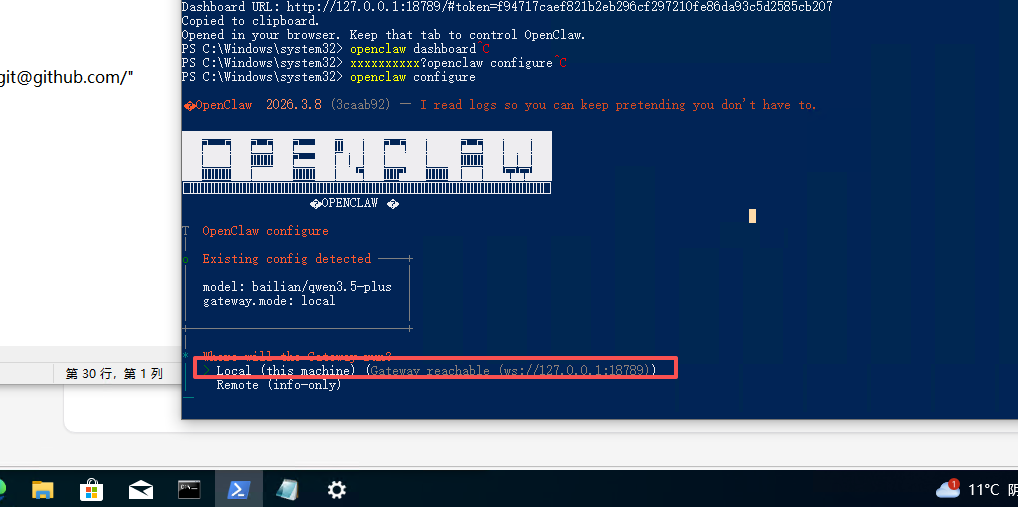

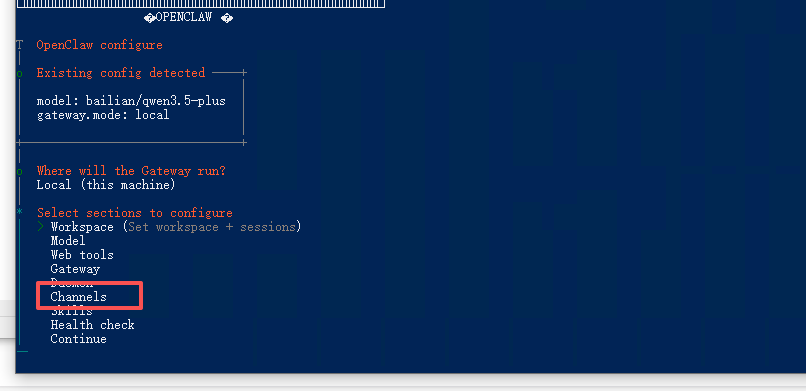

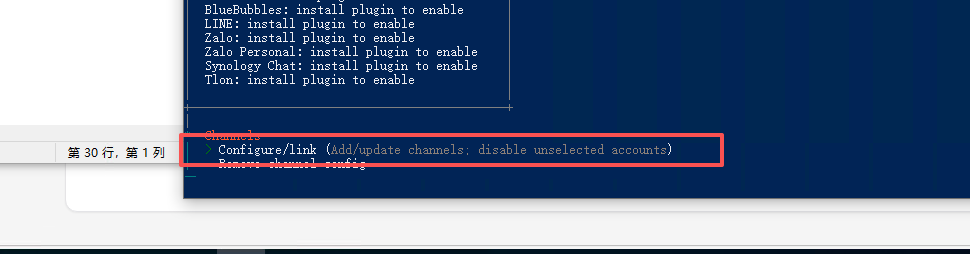

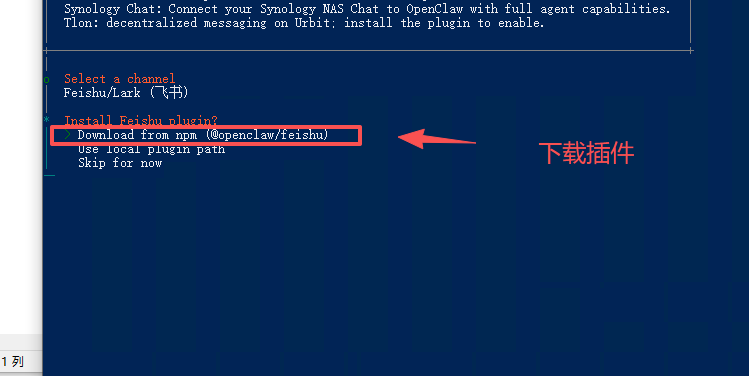

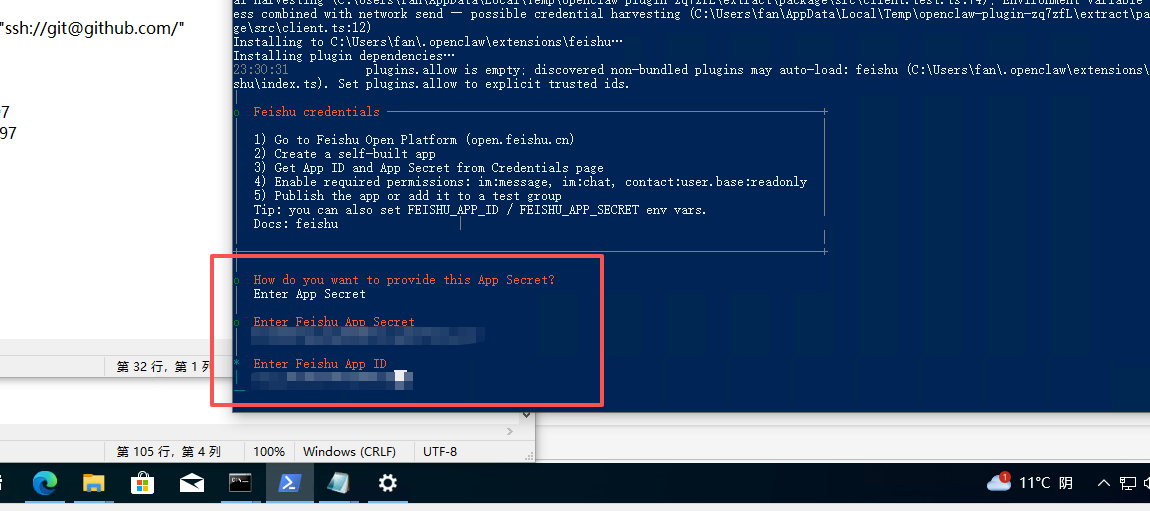

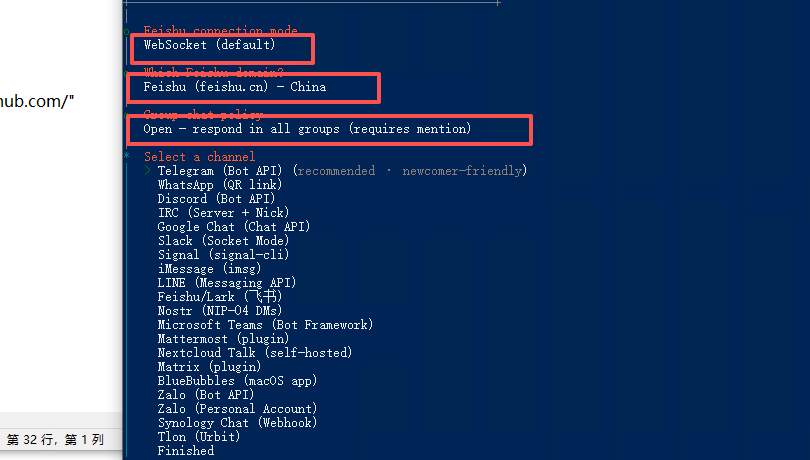

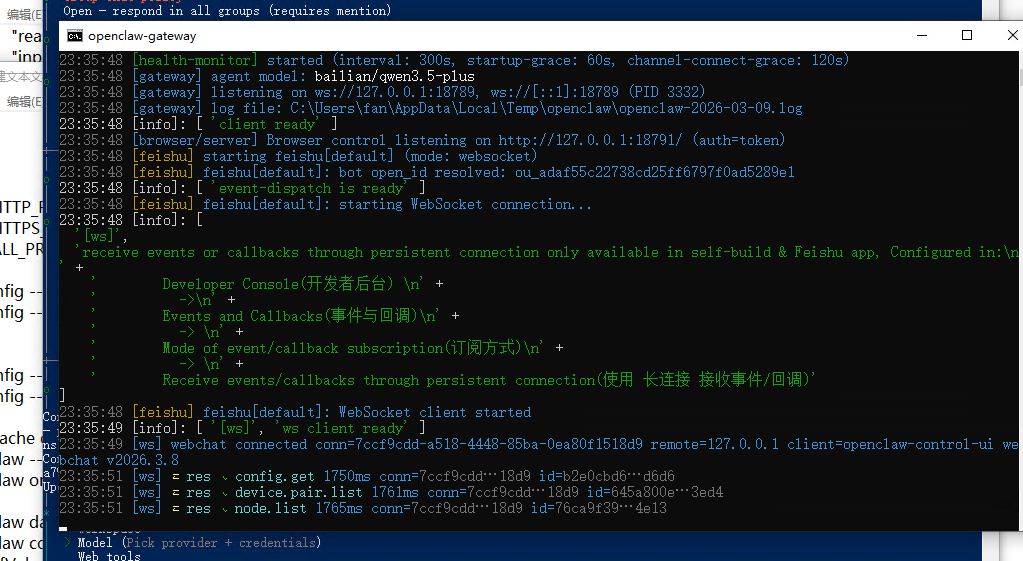

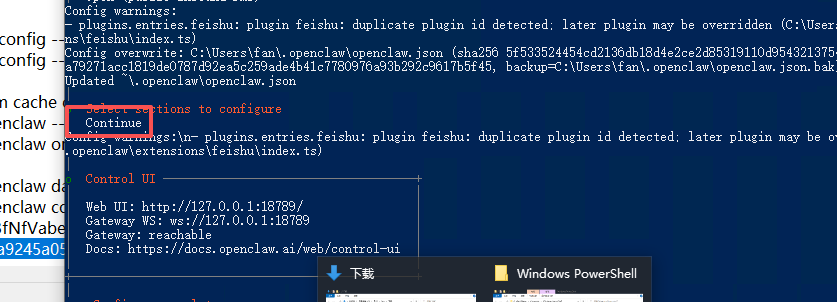

3. 在 OpenClaw 中添加飞书通道

回到 PowerShell,运行:

openclaw configure

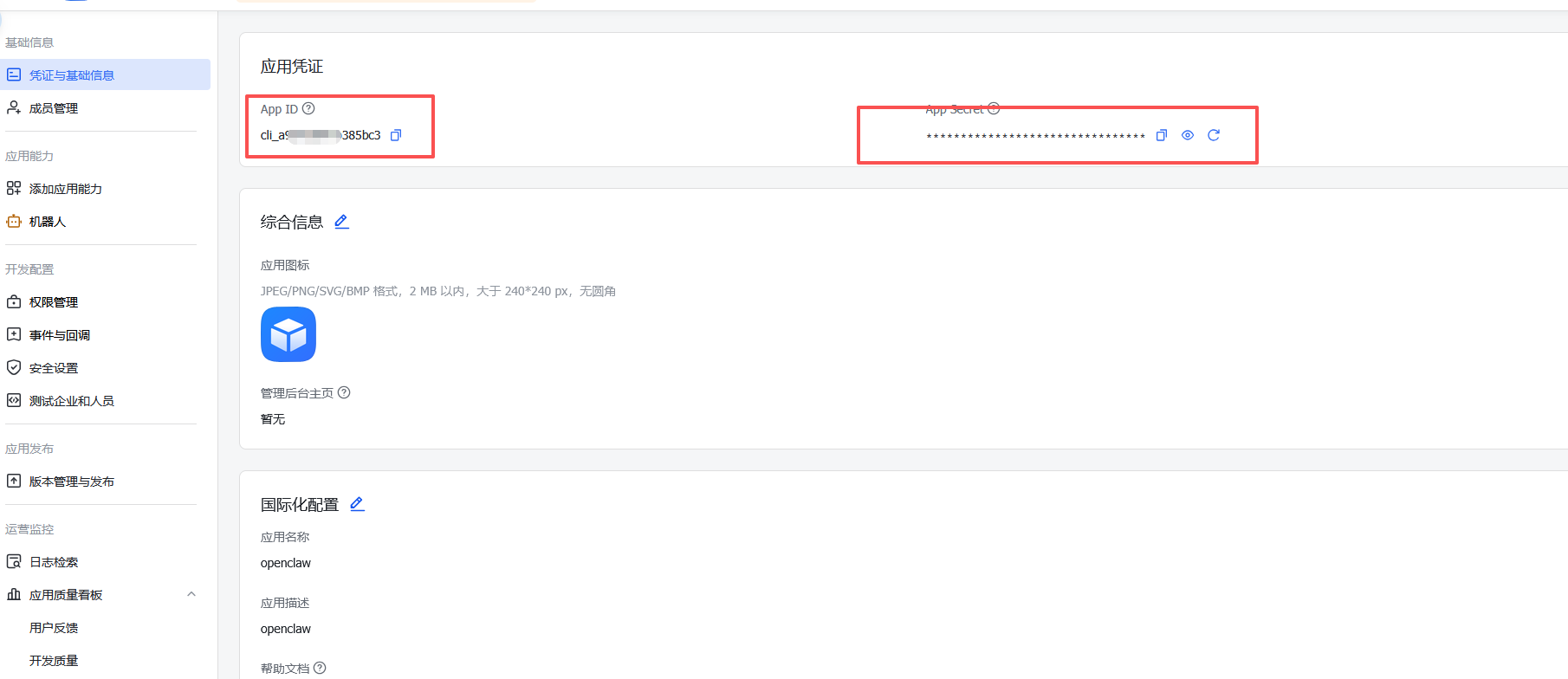

输入飞书的AppID,AppSecrect:

保存退出。

然后重启 OpenClaw 服务(或者直接关掉 Web UI 再重新运行 openclaw onboard)。

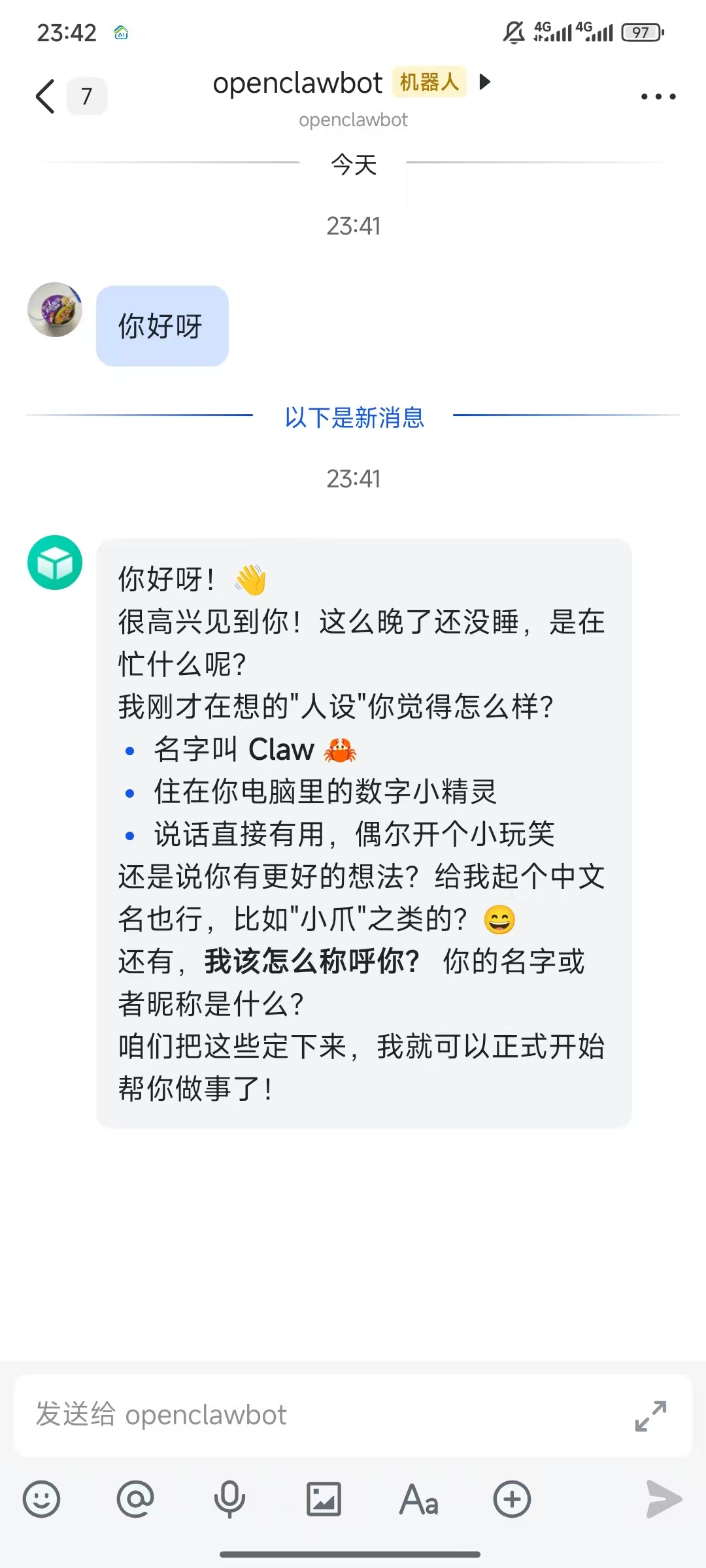

最后说两句

OpenClaw 不是玩具,它真能帮你干活。我上周让它自动整理了三个月的会议纪要,省了我至少五个小时。而且所有数据都在你本地,不像某些云服务偷偷传数据。

当然,它也有局限——比如需要一直开机、依赖大模型 API(可能有费用)、操作电脑有风险(所以它才让你确认“yes”)。但只要你理解这些,它就是你数字生活里的“贾维斯”。

如果你照着这篇教程走通了,不妨试试给它装几个 Skill(比如邮件处理、日程管理),玩法多得很。

觉得有用?别藏着掖着,转发给那个总喊“AI 太难搞”的同事,让他也体验一把什么叫“一句话搞定”。

关注我,带你玩转更多硬核又实用的运维/AI 工具!

公众号:运维躬行录

个人博客:躬行笔记 4